ロボットが人のホントを見抜いてる~センシング・AI技術の可能性

研究

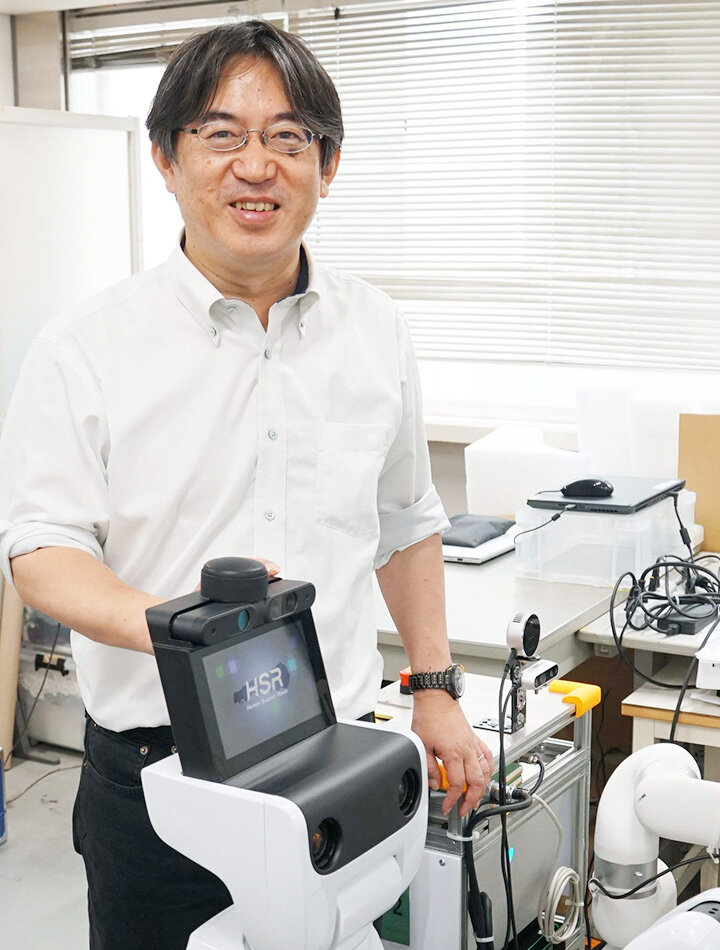

/システム理工学部 機械工学科 前泰志 教授

ロボットが人の状態や置かれている状況を察知することができれば、かゆいところに手の届くサポートが期待できる。人以上に人を理解してくれるロボットの誕生は実現可能か。そんなわくわくする研究を進めるシステム理工学部の前泰志教授に話を聞いた。

前教授が研究するのは、工場などの限定された空間で定められた作業をするロボットではなく、人が日常生活を送る空間で、人のために働くロボットである。日常空間で働くために必要なのが、複雑な空間のリアルなデータのセンシングやAIを使った情報処理の技術。それらとロボット技術を融合させて、「人と機械が調和する知能ロボットシステム」の実現を目指している。

研究の軸に据えるのが、画像認識の技術である。「ディープラーニングなどAIの技術が進化したことで、日常生活のような情報量の多い複雑な場所でも画像認識が可能になり、その精度も向上しています。ロボットがカメラを通して得た画像や映像を認識して動くようになることで、人に役立つさまざまなサービスの可能性が広がると思っています」

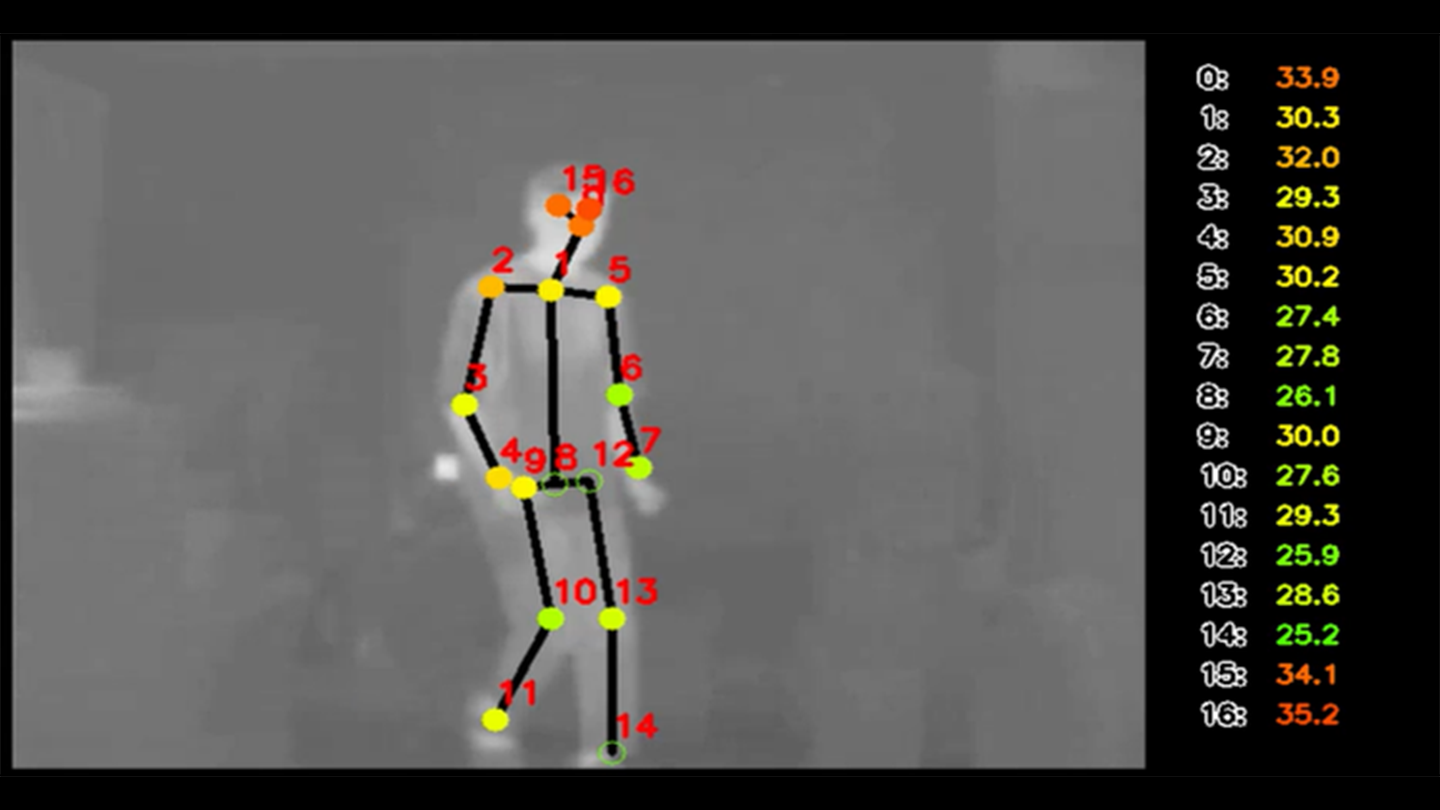

現在、前研究室で進めている研究テーマの一つが、人の姿勢と体表面の温度分布を同時に推定するセンシングシステムである。カラー画像に加えて赤外線を使って対象物の表面温度を計測するサーモグラフィカメラで人の姿勢を計測し,サーモグラフィカメラでセンシングした温度分布のデータを組み合わせてリアルタイムに表示するというものだ。

「例えば、夏の戸外で作業や運動をしている人に対して、ロボットが熱中症の傾向がないかをチェックしたり、『そろそろ水分補給や休憩をしてはどうですか』と提案できるといいですよね。人が気づかない早期の段階で、ロボットがデータを分析して体調不良の兆候に気づくことも可能になるのではないでしょうか」

また、こうしたセンシングによる人の動作解析は、いろいろと応用範囲も広いのではないかとも話す。例えば、ある動作に対して、どの部分の体表面温度が上がりやすいのかがわかると、その時の運動量がどれくらいになるかといった推定ができる。これにより健康作りやリハビリテーションなどの分野での応用も広がりそうだ。

前研究室では人の姿勢を推定する技術をさらに展開させ、カラー画像に加えて距離(深度)データも計測できるRGB-Dカメラを使い、人の姿勢を三次元でとらえてリアルタイムに計測し、人の日常動作を予測させる研究を進めている。人が何かの動作をする際に、その目的を予測し先回りしてサポートできるロボットにつながる研究テーマである。

最近の実験では、椅子の周りに4つの地点を設定し、どの場所の物体を取ろうとしているのかを予測させた。椅子に座っている人が各地点に置かれた物体を取る動作を動画に撮り、ディープラーニングの手法で情報を処理する。人が取ろうとしている物体を予測して、ロボットが先回りして物体を取ってあげるという想定だ。

実験の結果、かなりの精度で予測できることがわかった。動作のし始めは動きが少ないために予測が難しいようだが、その段階を過ぎるとかなり正しい予想が可能になった。今後は、もっと複雑な動作についても実験を積み重ねていくという。

前研究室では、人の行動の一歩先を読むだけでなく、人の心の状態を推測する研究も手掛けている。「コロナ禍以降、リモート会議やリモート授業がポピュラーになりましたが、やはり対面とは違って相手の状態がわかりにくい場合があります。そこで、モニターに映し出される画像から心拍数を推定できれば、人が緊張しているのかリラックスしているのかぐらいは分かるのではないかと考えました」心拍数が上がると、緊張や不安のせいで会議や授業に集中できていないかもしれないし、逆に下がればリラックスして集中している状態だと、大まかにつかめるというわけだ。

心拍数を推定する仕組みは、画像から人の顔を検出し、肌色の変化を時間を追って調べるのだという。肌の血液量の増減によって肌色が変化するのをリアルタイムで追いかけ、血液量の変化を推定して数値化。この値が心拍に応じて上下するため、そのピークの数から心拍数を割り出すというものだ。

実際にWEB会議システムの利用時に計測した結果では、心拍センサーとの差が毎分5回以内だった時間が全体の5~8割だったという。仕草や顔の向きによって顔検出ができないと精度が落ちるので、それも考えに入れるとまずまずの精度。しかも多くの人が参加する会議でも精度は変わらないという。顔画像を認証に使うようなシステムも実用化されているが、私たちの顔は想像以上にいろんなことを教えてくれるようだ。

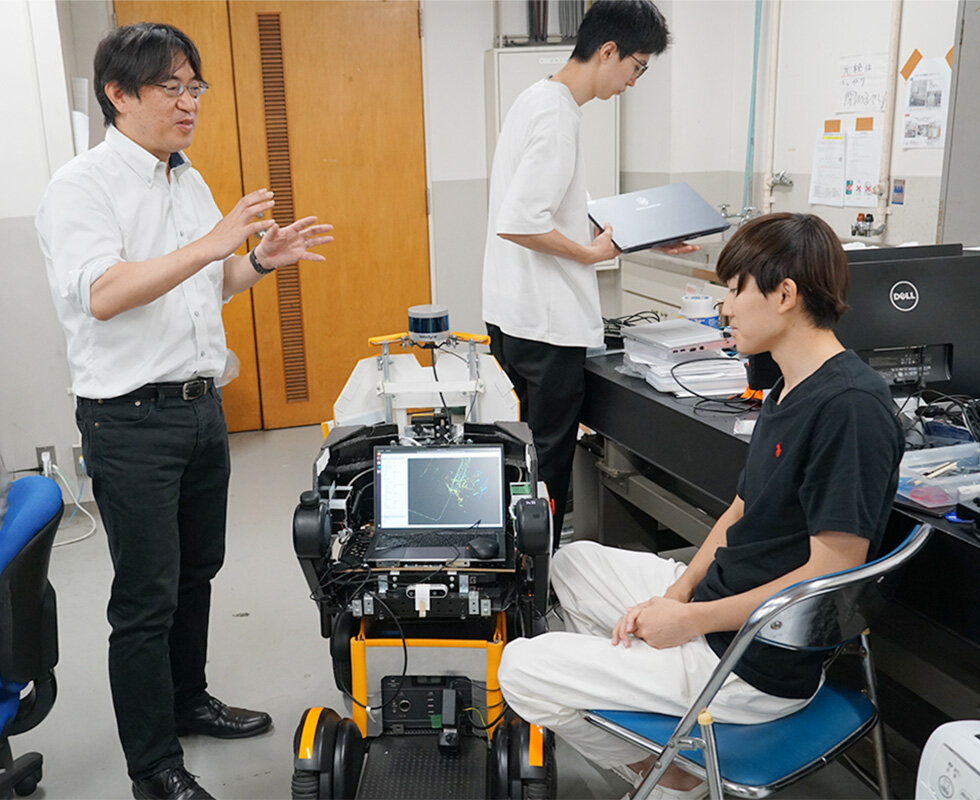

これまで伺ってきたような画像認識システムを組み込んで、働くロボットとして稼働させる研究も活発だ。ロボットによるゴミの分別回収の研究もその一つである。

「ロボットにRGB-Dカメラを付け、画像からペットボトルか缶かを識別させようとしています。日常の生活空間のように雑多な情報がある中で、ペットボトルや缶を見つけて、物体をつかみ、所定の回収箱まで運んで捨てるという、一連の動作ができることが目標です。事前にペットボトルや缶のデータを学習させておきますが、実際には、物体の一部が隠れていたり、汚れていたり、光が反射したりといった、さまざまな条件によって全く違う形状や色になってしまいます。それをいかに正しく認識させられるかがカギです」

この課題に対処するには、今の段階では、缶とペットボトルのデータについてなるべく多くのバリエーションを学習させておくしかなく、ビッグデータを扱えるような開発環境が不可欠だとか。しかし今後、ロボットが多様なパターンを自律的に学んでいくような仕組みの研究が進めば、汎用化への道も開けると前教授は言う。

ペットボトルに手を伸ばそうとした瞬間に先回りして手渡してくれたり、本棚の高いところにある本を見つめただけで取ってくれたりする、サービス精神旺盛なロボットと暮らす未来も、そう遠くはないのかもしれない。高齢者や障がいのある人にとっても、暮らしの質を上げてくれるような技術になりそうだ。前教授は、研究のビジョンについて次のように語る。

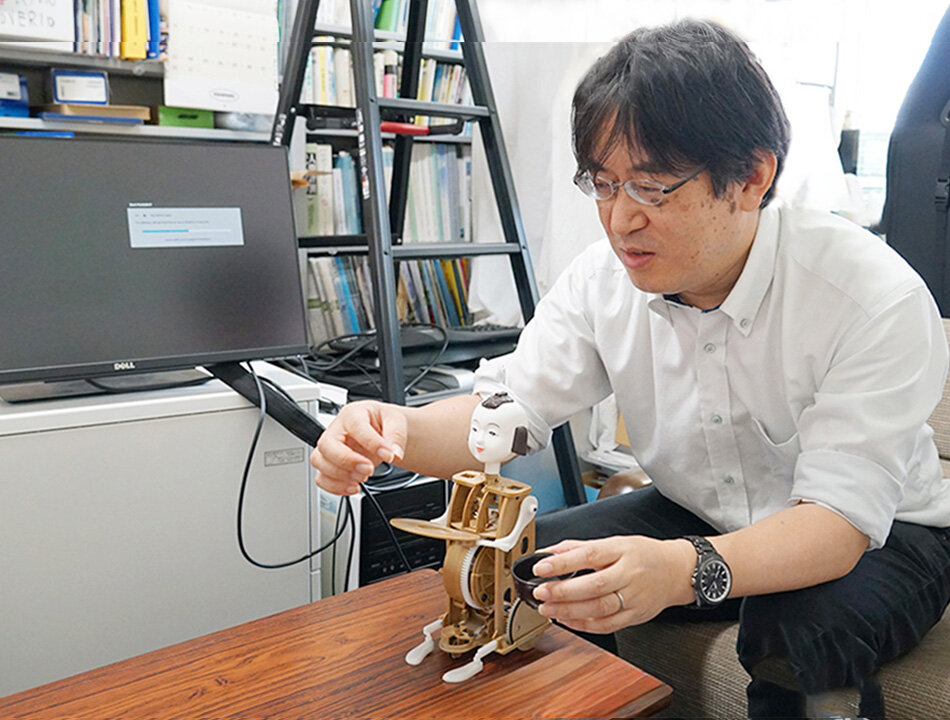

「人の近くで働くロボットには、安全であることはもちろん、できるだけ機械を意識せずに自然に人に接することができること、安心や親しみを感じられることが重要ではないかと思います。人の生活をずっと見ていて、人以上にその人のことがわかれば、そんな接し方が可能になるかもしれません。例えば、『あれ取って』と対象がはっきりしない言い方で頼まれても望むものを取ってあげられる、そんな人との関係を構築できるロボットを実現してみたいと思っています」